En ce moment, dans votre entreprise, quelqu’un colle des données clients dans ChatGPT. Un commercial reformule ses devis. Une RH analyse des CV. Un comptable « vérifie ses calculs ». Sans vous le dire. Ce phénomène a un nom : le Shadow AI.

Et il concerne probablement 60 à 80 % de vos équipes. Voici pourquoi ça arrive, pourquoi c’est risqué, et surtout comment transformer ce problème en opportunité.

Dans cet article, vous trouverez :

- Ce qu’est le Shadow AI et pourquoi il explose dans les PME françaises

- Les vrais risques juridiques et sécuritaires pour votre entreprise

- Une méthode en 4 étapes pour encadrer ça proprement

- Un exemple concret de PME qui a transformé le problème en opportunité

Le Shadow AI, c’est quoi exactement ?

On connaît le Shadow IT : ces logiciels que les employés installent sans passer par la DSI. Le Shadow AI, c’est la même chose, mais avec ChatGPT, Claude ou Gemini.

Le terme « Shadow AI » désigne l’utilisation de ChatGPT ou d’autres IA génératives dans un contexte professionnel sans approbation préalable de la hiérarchie. En 2023, 30 % des salariés étaient dans cette situation. Cette réalité touche désormais 68 % des entreprises françaises.

Ce phénomène touche toutes les tailles de structures y compris les PME lyonnaises qui investissent massivement dans l’IA en ce moment.

Et ce n’est pas un phénomène de grandes entreprises tech. En janvier 2026, 73 % des employés utilisent des outils d’intelligence artificielle sans en informer leur direction. ChatGPT, Midjourney, Claude ou Gemini sont devenus des compagnons quotidiens pour rédiger des emails, créer des présentations ou analyser des données. Et selon une étude Gartner, 68 % des dirigeants ignorent totalement cette réalité dans leur entreprise.

Autrement dit : le Shadow AI, c’est déjà maintenant. Pas dans deux ans.

Pourquoi vos équipes le font en cachette

La première question à se poser n’est pas « comment les arrêter ? » mais « pourquoi ils le font ? ».

La réponse est simple. 87 % des employés indiquent que leur entreprise n’a pas défini de politique claire sur l’usage de l’IA générative. Et selon l’IFOP, 72 % des utilisateurs français d’IA générative choisissent ChatGPT, alors que seulement 39 % des entreprises le proposent à leurs équipes.

Le vide crée l’usage sauvage. Vos employés ne sont pas malveillants : ils cherchent à aller plus vite, à mieux travailler. Dans la majorité des cas, ils agissent par souci d’efficacité : gagner du temps dans la rédaction d’emails, le traitement de documents, la génération de contenu ou le support client.

Pourtant, 68 % des utilisateurs de ChatGPT le cachent à leur hiérarchie. Près de la moitié refuserait de cesser même si l’outil était interdit.

Interdire sans accompagner ne sert à rien. Ça empire même les choses : parce que ça pousse les usages encore plus dans l’ombre.

Les vrais risques pour votre PME

Ce n’est pas du catastrophisme. Ce sont des risques juridiques et stratégiques concrets.

Fuite de données et RGPD

Chaque prompt envoyé à ChatGPT ou Claude depuis un compte personnel représente une transmission de données vers des serveurs externes, hors de tout contrôle de l’entreprise. Un commercial qui copie-colle sa base clients pour demander une segmentation, un juriste qui partage un contrat pour en extraire les clauses clés, un ingénieur qui partage du code propriétaire pour du debugging : les modèles gratuits stockent et exploitent ces informations pour leur propre entraînement.

Dès qu’un employé copie des informations clients dans ChatGPT, votre entreprise enfreint potentiellement le RGPD. Vous transférez des données personnelles vers des serveurs américains sans base légale appropriée. La CNIL a déjà sanctionné plusieurs entreprises pour ce type de pratique en 2025.

Un sujet que nous avons déjà creusé en détail dans notre article sur ChatGPT et la sécurité de vos données.

Un exemple concret qui fait froid dans le dos

En 2023, Samsung a été pris au piège de ChatGPT. Ses employés l’ont utilisé à trois reprises et ont transmis de fait à OpenAI des données strictement confidentielles, notamment le code source de ses puces électroniques.

Samsung. Pas une startup de 15 personnes.

Responsabilité juridique

La responsabilité juridique de l’entreprise reste entière en cas d’erreur commise par l’IA. Si un collaborateur génère un rapport erroné avec ChatGPT, ou si un commercial envoie une proposition contractuelle « hallucinée » par l’IA, c’est l’entreprise qui endosse la responsabilité légale des dommages causés aux clients ou partenaires.

Une bombe à retardement sécuritaire

Selon une étude de juin 2025, plus de 80 % des organisations présentent des signes d’activité Shadow AI. Gartner prévoit que 40 % d’entre elles subiront une faille de sécurité liée à ce phénomène d’ici 2030.

La bonne réaction : encadrer, pas interdire

L’erreur classique des dirigeants face au Shadow AI ? Envoyer un email d’interdiction.

Résultat garanti : les usages continuent, mais encore plus discrètement. Dans les entreprises qui interdisent formellement l’IA, 43 % des employés continuent de l’utiliser régulièrement.

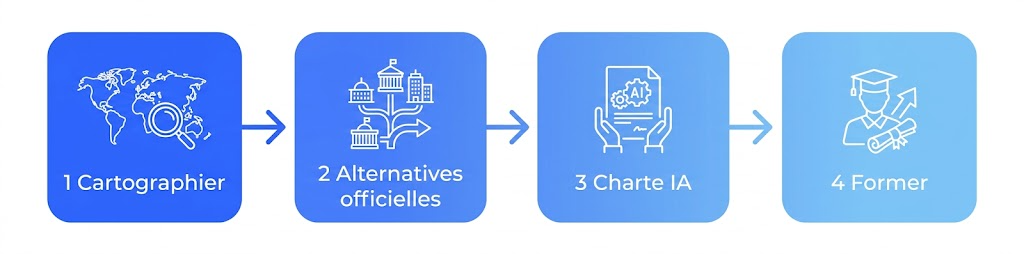

La bonne approche, c’est en quatre étapes.

Étape 1 : Cartographier avant de réagir

L’objectif n’est pas de sanctionner, mais de comprendre. Organisez des entretiens individuels confidentiels avec cette question simple : « Quels outils numériques utilisez-vous quotidiennement que l’entreprise ne vous a pas fournis ? » Cette formulation neutre encourage la transparence. En général, vos employés seront soulagés de pouvoir parler ouvertement de leurs pratiques.

Ce premier audit est souvent révélateur : vous découvrez des usages pertinents que vous n’aviez pas imaginés.

Étape 2 : Proposer des alternatives officielles sécurisées

Plutôt que de simplement interdire, les entreprises doivent mettre en place des plateformes qui canalisent naturellement les initiatives IA. L’exemple de Danone est éclairant : en déployant massivement Microsoft Copilot auprès de 5 000 collaborateurs sur 90 jours, l’entreprise a développé des cas d’usage concrets tout en réduisant drastiquement le Shadow AI.

Pour une PME, cela peut être aussi simple que de souscrire à Claude Team ou ChatGPT Enterprise : des versions où vos données ne sont pas réutilisées pour entraîner les modèles.

Étape 3 : Rédiger une charte IA claire

Pas un document de 40 pages. Une page A4 qui répond à trois questions :

- Quels outils sont autorisés, dans quels contextes ?

- Quelles données ne doivent jamais être copiées dans une IA ?

- Que faire en cas de doute ?

La gouvernance doit être pragmatique, basée sur un diagnostic de la situation réelle, et suffisamment flexible pour évoluer avec les technologies.

Étape 4 : Former, pas juste informer

69 % des utilisateurs n’ont reçu aucune formation sur les risques liés à l’IA. Beaucoup pensent, à tort, qu’il suffit de ne pas donner de noms pour éviter les problèmes.

C’est exactement pour ça qu’OMIA a conçu ses formations IA en entreprise : donner à vos équipes les bons réflexes, métier par métier, sans jargon technique. Une session de deux heures suffit souvent à transformer des utilisateurs clandestins en utilisateurs responsables. L’enjeu n’est pas de faire peur : c’est de reprendre la main.

Le Shadow AI, révélateur d’une opportunité manquée

Voilà le paradoxe : derrière chaque usage non autorisé se cache souvent une demande légitime d’innovation et d’amélioration de productivité. Les entreprises qui sauront transformer ce défi en opportunité d’innovation sécurisée construiront l’avantage compétitif de demain.

Vos employés qui utilisent ChatGPT en secret ne sont pas un problème RH. Ce sont vos futurs ambassadeurs IA, à condition de les accompagner correctement.

Conclusion

Le Shadow AI n’est pas une tendance passagère. C’est le reflet d’un besoin réel que vos équipes ont trouvé comment combler avec ou sans vous. La vraie question n’est pas « comment l’interdire ? » mais « comment reprendre la main proprement ? ». Cartographie des usages, charte claire, outils officiels sécurisés, formation ciblée : quatre étapes suffisent pour transformer un risque invisible en levier de productivité maîtrisé.

OMIA accompagne les PME du Rhône pour réaliser leur audit IA, former leurs équipes et structurer une gouvernance IA adaptée à leur réalité. ← Demandez votre audit

FAQ — Shadow AI en entreprise

Pas illégal au sens pénal du terme. Mais si un employé transmet des données clients ou confidentielles dans un outil non approuvé, c’est votre entreprise qui engage sa responsabilité juridique, notamment vis-à-vis du RGPD. L’intention importe peu : c’est le résultat qui compte pour la CNIL.

Le Shadow IT désigne l’usage de logiciels non autorisés en général. Le Shadow AI est une sous-catégorie spécifique aux outils d’IA générative comme ChatGPT, Claude ou Gemini. La différence majeure : avec le Shadow AI, chaque interaction peut potentiellement transmettre des données sensibles vers des serveurs externes.

Oui, à la différence de la version gratuite. ChatGPT Enterprise et Claude Team garantissent contractuellement que vos données ne sont pas utilisées pour entraîner les modèles. C’est le minimum requis pour une utilisation professionnelle conforme.

Une demi-journée suffit pour une PME de moins de 50 personnes. L’enjeu n’est pas la longueur du document, c’est sa clarté. Une page A4 bien rédigée vaut mieux qu’un règlement intérieur de 20 pages que personne ne lit.

Par l’audit, pas par la sanction. Identifiez les outils utilisés, comprenez les besoins derrière, puis structurez une réponse adaptée. C’est exactement ce que nous proposons chez OMIA avec l’ audit IA, une cartographie complète de vos usages en deux à trois jours.

Sources :

Harmonic Security — The AI Tightrope : Shadow AI et données sensibles en entreprise : harmonic.security

Inria × Datacraft — Shadow AI : les salariés français s’emparent de l’IA en secret : silicon.fr

Gartner — 40 % des entreprises exposeront une faille Shadow AI d’ici 2030 : everdata.fr

Salesforce — 68 % des salariés français adeptes du Shadow AI : dfm.fr

90 % des entreprises comptent des employés utilisant l’IA sans autorisation : dfm.fr