AI Act 2026 : ce qui change pour les entreprises. Une méthode simple pour classer vos usages IA et être prêt avant le 2 août, sans prise de tête.

Si votre entreprise utilise déjà l’IA (assistants de rédaction, chatbots, analyse de documents, outils métiers…), l’enjeu est simple : savoir quels outils vous utilisez, pour quoi, avec quelles données et quelles garanties vous avez mises en place.

Dans cet article, vous trouverez :

- une explication simple de ce qu’est l’AI Act (et qui est concerné),

- une méthode rapide pour classer vos usages selon le niveau de risque,

- une checklist en 10 actions (données, fournisseurs, registre, formation) pour être prêt avant août 2026, sans complexifier votre organisation.

Objectif : repartir avec un plan concret à appliquer dès maintenant, même dans une PME sans équipe juridique dédiée.

Pour aller plus loin, vous pouvez aussi lire notre article : Lyon : pourquoi les PME investissent dans l’IA (méthode, sécurisation des données et déploiement concret).

Pourquoi 2026 est l’année pivot

L’AI Act (le règlement européen sur l’IA) s’applique de manière progressive. Le jalon principal est le 2 août 2026 : à cette date, le texte devient pleinement applicable, avec quelques exceptions (notamment certaines règles “high-risk” intégrées à des produits déjà très réglementés, avec une transition jusqu’au 2 août 2027).

Voir le calendrier officiel : Commission européenne.

En clair : si vous attendez l’été 2026, vous arrivez tard. L’objectif réaliste, c’est d’avoir un cadre simple en place bien avant, pour que l’usage de l’IA devienne “normal” dans l’entreprise… et documenté.

Concrètement, c’est quoi l’AI Act ?

L’AI Act est le cadre légal de l’Union européenne qui fixe des règles pour développer, commercialiser et utiliser des systèmes d’intelligence artificielle dans l’UE.

Le texte ne cherche pas à bloquer l’adoption. Il cherche à éviter les usages à risque et à rendre l’IA plus sûre et plus transparente. Pour une entreprise, l’AI Act revient surtout à pouvoir répondre à cinq questions très simples :

- Quels outils d’IA utilise-t-on ? (y compris ceux “testés vite fait”)

- Pour faire quoi ? (rédaction, support, RH, scoring, analyse de documents…)

- Avec quelles données ? (clients, RH, juridique, documents internes…)

- Quel niveau de risque ? (faible, transparence, high-risk, interdit)

- Quels garde-fous et quelles preuves ? (validation, supervision humaine, registre, choix fournisseurs, formation)

Autre point important : l’AI Act ne concerne pas seulement “ceux qui créent de l’IA”. Il distingue plusieurs rôles, mais en pratique, deux vous intéressent :

- Le fournisseur (provider) : l’éditeur qui met le système sur le marché.

- Le déployeur (deployer) : l’entreprise qui l’utilise dans ses process.

Si vous voulez consulter la version officielle du texte : EUR-Lex (Règlement UE 2024/1689).

Même si vous ne développez rien, vous pouvez avoir des obligations en tant que déployeur, surtout si l’IA touche à des domaines sensibles, ou si elle interagit avec des utilisateurs.

Comment l’AI Act classe le risque :

Le principe est simple : plus le risque est élevé, plus les obligations sont fortes.

1) Risque inacceptable : interdit

Certains usages sont prohibés. C’est rarement le cas en PME, mais il faut vérifier si vous touchez à des scénarios sensibles.

2) “High-risk” : fortement encadré

Ce sont des systèmes utilisés dans des contextes considérés comme sensibles (selon des listes précises dans le texte). Ici, la conformité repose sur un vrai socle : supervision humaine, documentation, traçabilité, gestion des incidents, qualité des données, etc.

3) Risque limité : obligations de transparence

Exemple typique : un chatbot au contact d’utilisateurs. Dans certains cas, il faut rendre l’usage de l’IA explicitement visible (et encadrer les contenus générés/manipulés).

4) Risque minimal : la majorité des usages du quotidien

Beaucoup d’usages “productivité” restent à faible risque au sens AI Act. Mais faible risque ne veut pas dire “sans règles” : RGPD, confidentialité, sécurité et contrats restent votre responsabilité.

Ce que ça implique concrètement pour une entreprise

Si vous n’entraînez pas un modèle en interne, votre enjeu principal n’est pas “la conformité d’un modèle”. Votre enjeu, c’est la conformité de vos usages.

Dans la pratique, tout se joue sur trois axes :

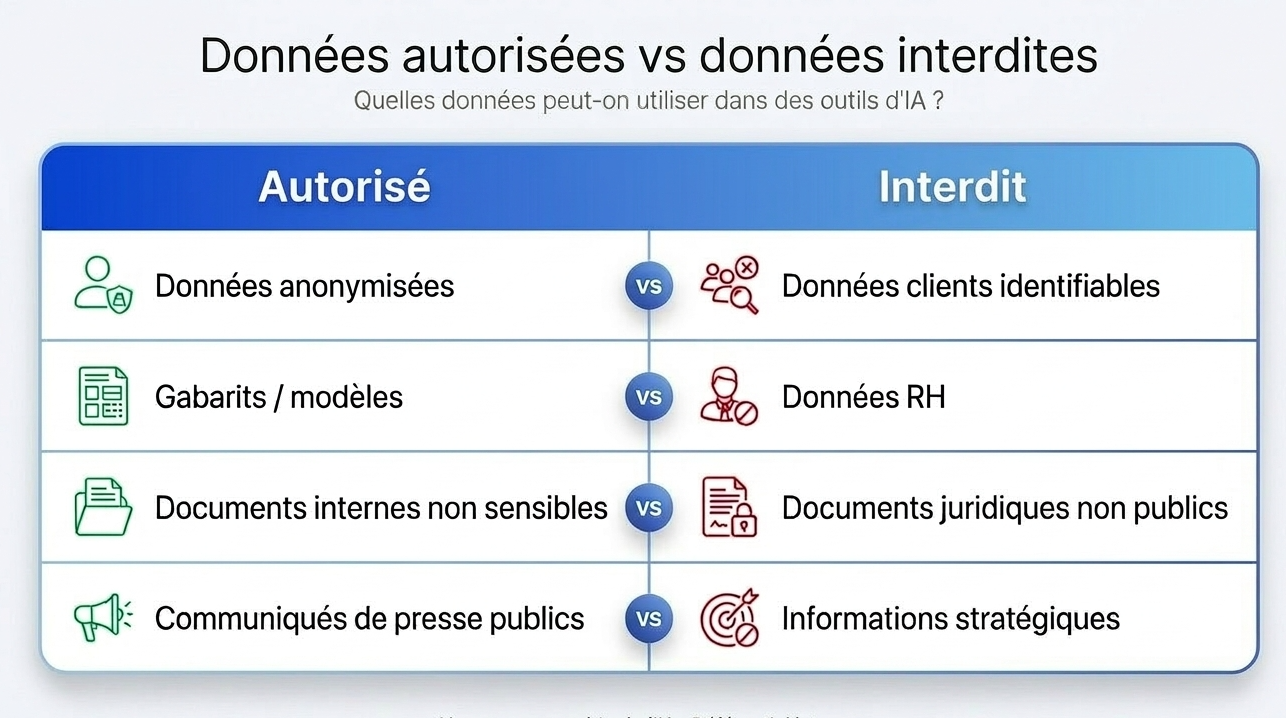

- Données : ce qui est autorisé / interdit, comment on anonymise, où ça transite.

- Usages : ce qu’on fait avec l’IA, qui valide, quelles limites, quel contrôle humain.

- Fournisseurs : quelles garanties l’éditeur apporte et ce que vous devez conserver comme preuves.

Checklist 2026 : 10 actions simples pour être prêt avant le 2 août

1: Mettre la lumière sur vos usages

- Listez les usages IA réels (outils, équipes, objectifs, données utilisées).

- Classez chaque usage : interdit / high-risk / transparence / minimal.

- Nommez un responsable (ou binôme) : qui arbitre, qui valide, qui tranche en cas de doute.

2: Cadrer le sujet données (le vrai point de risque)

- Rédigez une règle claire “données autorisées / interdites” (avec des exemples concrets).

- Créez 2 à 3 gabarits d’anonymisation (exemples “propres” prêts pour les équipes).

- Définissez un circuit simple : qui valide un nouvel usage et où la décision est documentée.

3: Faire le tri côté fournisseurs

- Pour chaque outil : clarifiez où sont traitées les données, la rétention, les sous-traitants et les options de confidentialité.

- Conservez une fiche “outil” : usage, données, risques, mesures, propriétaire interne, documentation disponible.

4: Passer en mode “preuve”

- Mettez en place un registre des cas d’usage (un tableau suffit) : objectif, données, équipe, validation, garde-fous.

- Déployez une sensibilisation des équipes à l’IA : (courte, obligatoire, orientée erreurs fréquentes). Cette obligation est déjà entrée en application : mieux vaut la traiter comme un standard interne, pas comme une contrainte.

Pour accélérer la mise en conformité côté équipes, le plus efficace reste une formation courte et concrète : notre formation IA en entreprise.

Les 6 erreurs fréquentes (et comment les éviter)

- “On utilise juste un outil, ce n’est pas sérieux.” → La vraie question : avec quelles données, et dans quel process.

- Une charte IA trop vague. → Si personne ne sait quoi faire lundi matin, elle ne sert à rien.

- Penser que “le fournisseur gère tout”. → Vous restez responsable de vos usages et de vos choix de données.

- Oublier la transparence quand l’IA interagit avec des utilisateurs.

- Ne rien tracer. → Le jour où une question tombe (client, audit, incident), le manque de registre devient votre point faible.

- Attendre 2026 pour s’y mettre. → L’adoption “propre” se construit progressivement.

FAQ — AI Act 2026

Oui, dès lors que vous utilisez ou déployez des systèmes d’IA dans l’UE. L’intensité des obligations dépend du niveau de risque et de votre rôle (fournisseur ou déployeur).

Non. En revanche, vous devez encadrer les usages : données autorisées/interdites, transparence selon les cas, formation/sensibilisation, et gouvernance.

Créer un registre des usages (même minimal), puis écrire une règle “données autorisées / interdites”. C’est le socle le plus rentable et le plus protecteur.

Passer à l’action

Besoin d’un accompagnement pour sécuriser vos usages ou mettre en conformité votre entreprise ? Découvrez nos solutions concrètes sur le site d’OMIA.

→ Voir nos services d’accompagnement«

Sources :

Reuters — Point d’actualité sur les débats autour du calendrier : reuters.com

Commission européenne — Cadre réglementaire de l’IA (AI Act) : digital-strategy.ec.europa.eu

AI Act Service Desk (UE) — Calendrier de mise en œuvre : ai-act-service-desk.ec.europa.eu

EUR-Lex — Texte officiel (Règlement UE 2024/1689) : eur-lex.europa.eu